O que é Inteligência Artificial? Origem, Evolução e Estado Atual

A Inteligência Artificial (IA) é um campo da ciência da computação dedicado ao desenvolvimento de sistemas capazes de realizar tarefas que, até recentemente, exigiriam a cognição humana. Isso inclui, por exemplo, o reconhecimento de voz e de imagens, a tradução entre idiomas naturais, a resolução de problemas complexos e até mesmo a criação de textos e obras de arte.

Definida de forma clássica por Elaine Rich (1983), IA é ‘o campo de estudo que busca construir sistemas computacionais capazes de realizar tarefas associadas à inteligência humana’. Essa definição abre um leque de possibilidades, pois o que é considerado ‘inteligente’ pode variar dependendo do contexto histórico, cultural e técnico.

Ao longo das décadas, estudiosos de diversas áreas — desde a psicologia até a filosofia, passando pela neurociência e pela lógica — contribuíram para a construção do que hoje entendemos por IA. Howard Gardner, por exemplo, introduziu o conceito de inteligências múltiplas, ampliando o escopo tradicionalmente limitado à lógica e à linguagem verbal. Marvin Minsky, um dos fundadores da IA moderna, via a mente como uma sociedade de agentes, cada um responsável por um tipo de processamento.

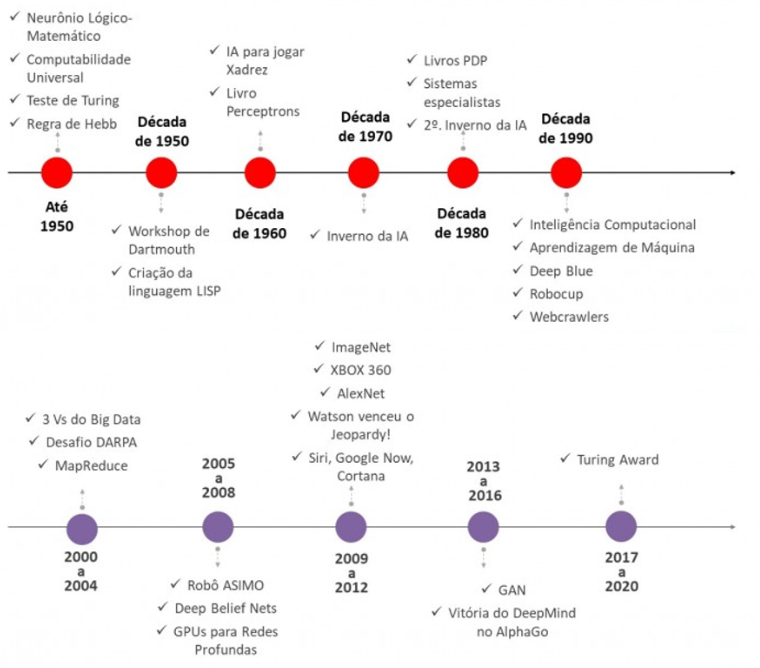

A jornada da IA começa formalmente com os questionamentos de Alan Turing na década de 1950, especialmente com a famosa pergunta ‘As máquinas podem pensar?’. O Teste de Turing, concebido por ele, ainda é uma referência no debate sobre consciência e simulação de comportamento humano por máquinas.

Nas décadas seguintes, marcos como a Conferência de Dartmouth (1956), liderada por John McCarthy, Minsky, Rochester e Shannon, estabeleceram as bases acadêmicas da IA. Desde então, diferentes abordagens foram desenvolvidas: a simbólica, baseada em lógica formal; a conexionista, baseada em redes neurais artificiais; e a evolucionária, que imita os processos de seleção natural.

A história da IA é marcada por ciclos de entusiasmo e frustração, com períodos de grandes investimentos seguidos por fases de descrença — os chamados ‘invernos da IA’. Ainda assim, cada nova onda trouxe avanços duradouros, culminando no atual renascimento da IA, impulsionado pela disponibilidade de grandes volumes de dados e pelo aumento exponencial do poder computacional.

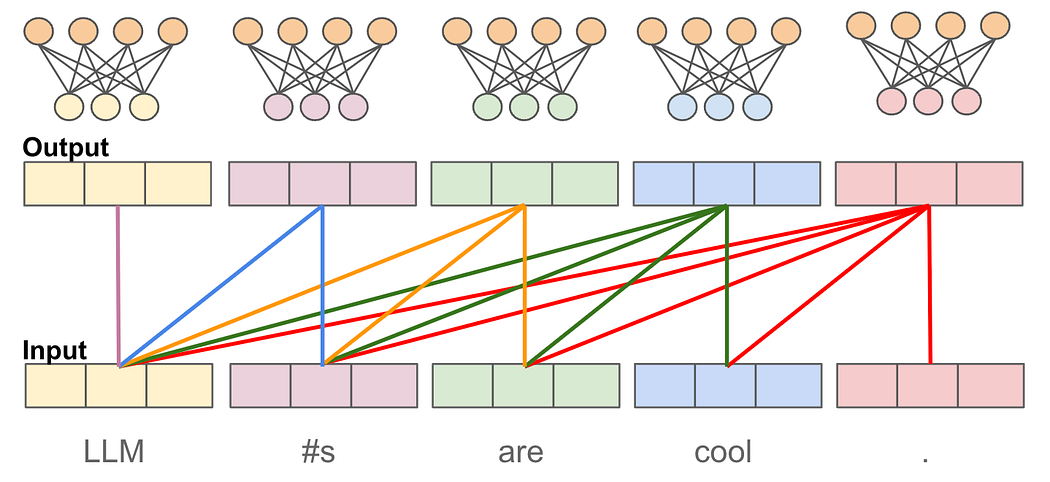

Hoje, vivemos uma era em que os modelos de linguagem de larga escala (LLMs – Large Language Models em inglês), como o GPT, transformaram radicalmente o modo como interagimos com computadores. Esses modelos são treinados em bilhões de palavras e são capazes de gerar textos coerentes, responder perguntas complexas e até mesmo criar novos conteúdos de maneira autônoma.

A IA atual está presente em assistentes virtuais, veículos autônomos, sistemas de recomendação, robótica avançada e diagnóstico médico assistido por computador. Os desafios continuam, principalmente nos campos da ética, privacidade, transparência e controle sobre sistemas cada vez mais autônomos.

Em suma, compreender a IA é mergulhar em uma das maiores aventuras intelectuais da humanidade — a tentativa de entender e reproduzir, por meios artificiais, aquilo que nos torna humanos: nossa inteligência.

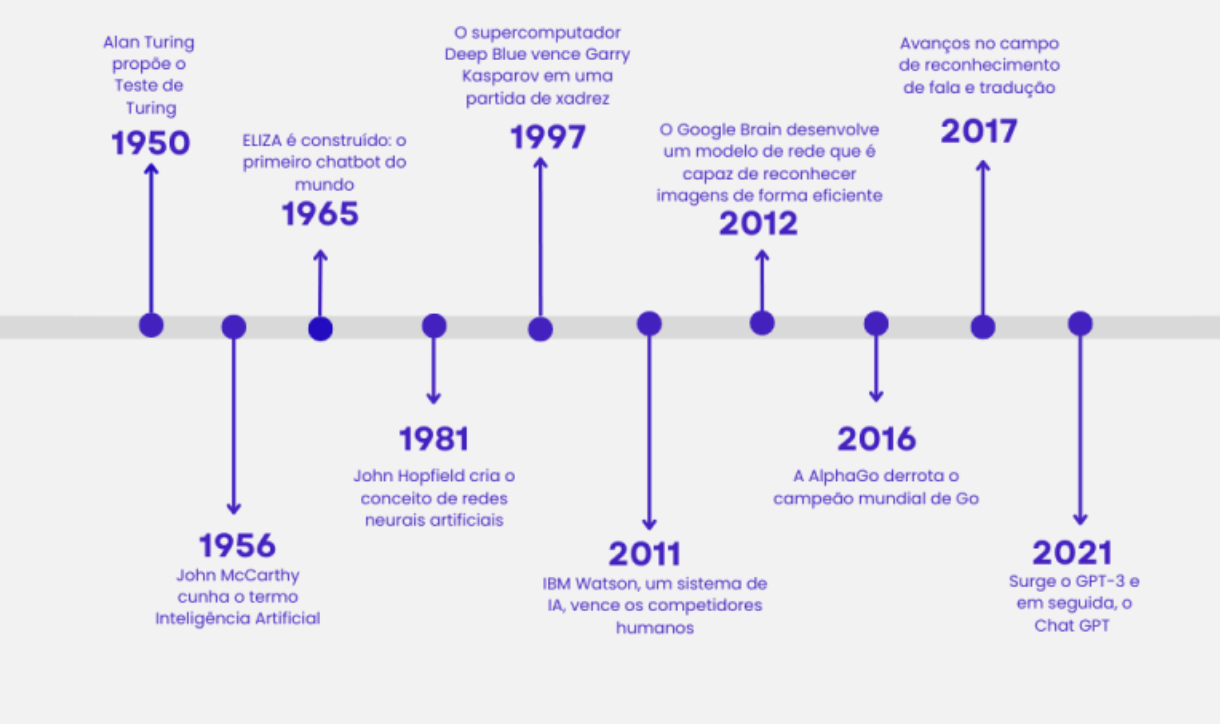

Linha do Tempo: Breve História da Inteligência Artificial

A história da Inteligência Artificial (IA) é uma fascinante jornada de ideias, descobertas, desafios e renascimentos. Desde suas origens, o campo foi impulsionado tanto por visões otimistas quanto por barreiras tecnológicas e filosóficas. A trajetória da IA pode ser compreendida como uma sucessão de períodos de avanços significativos, seguidos por momentos de estagnação e descrédito, conhecidos como ‘invernos da IA’. Cada nova onda de desenvolvimento, no entanto, trouxe contribuições valiosas, consolidando o que hoje entendemos como um dos campos mais promissores da ciência e da tecnologia.

- 1950 – Alan Turing publica o artigo ‘Computing Machinery and Intelligence’, no qual introduz a célebre pergunta ‘As máquinas podem pensar?’. Neste trabalho seminal, Turing propõe o que mais tarde seria chamado de ‘Teste de Turing’, um experimento para avaliar a habilidade de uma máquina em exibir comportamento inteligente indistinguível de um ser humano.

- 1956 – A Conferência de Dartmouth, realizada no Dartmouth College, nos Estados Unidos, é considerada o marco inaugural da IA como disciplina científica. Reunindo pesquisadores visionários como John McCarthy, Marvin Minsky, Nathaniel Rochester e Claude Shannon, o encontro deu origem ao termo ‘Inteligência Artificial’ e delineou os primeiros objetivos de pesquisa da área.

- 1966 – Surge o Eliza, criado por Joseph Weizenbaum no MIT. Este foi o primeiro chatbot capaz de simular diálogos com seres humanos, utilizando padrões pré-programados de resposta. Eliza imitava um psicoterapeuta Rogeriano e demonstrou que, mesmo sem compreender linguagem, uma máquina poderia convencer interlocutores de que estavam falando com um humano.

- 1980 – Os sistemas especialistas se tornam populares. Um dos mais conhecidos foi o MYCIN, projetado para diagnosticar infecções bacterianas e sugerir tratamentos. Esses sistemas imitavam a lógica de especialistas humanos em domínios específicos, utilizando regras if-then (se-então) para a tomada de decisões.

- 1997 – O supercomputador Deep Blue, da IBM, vence o campeão mundial de xadrez Garry Kasparov. Foi um momento histórico para a IA simbólica, demonstrando que computadores poderiam superar seres humanos mesmo em tarefas cognitivas altamente complexas e estratégicas, como o xadrez.

- 2011 – O sistema Watson, também da IBM, derrota dois campeões humanos no popular programa de perguntas e respostas Jeopardy!. Diferente do Deep Blue, o Watson lidava com linguagem natural e ambiguidade semântica, destacando o potencial da IA para o processamento de linguagem humana.

- 2016 – O AlphaGo, desenvolvido pela DeepMind (subsidiária do Google), vence o campeão mundial de Go, Lee Sedol. Go é um jogo milenar de origem oriental, muito mais complexo que o xadrez em termos de possibilidades táticas. A vitória foi possível graças ao uso de redes neurais profundas e aprendizado por reforço, marcando uma nova era para o campo de IA conexionista.

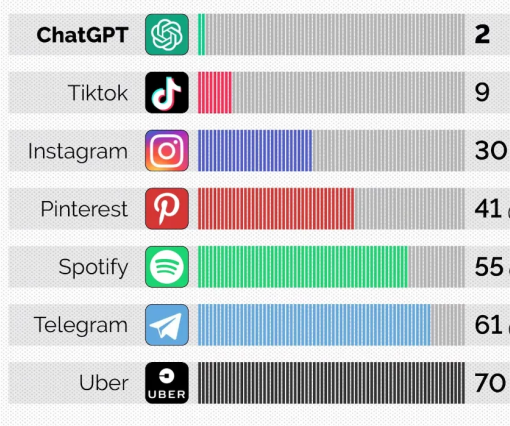

- 2022 – O ChatGPT, lançado pela OpenAI, populariza os Modelos de Linguagem de Larga Escala (LLMs). Capaz de gerar textos com fluência e coerência impressionantes, o ChatGPT marca a entrada da IA no cotidiano das pessoas, influenciando educação, trabalho, cultura e comunicação. Com base na arquitetura Transformer, esses modelos tornaram-se ferramentas versáteis e amplamente acessíveis.

Paradigmas da Inteligência Artificial: Tipos e Aplicações

1. Tipos de Inteligência Artificial

IA Fraca (Narrow AI)

É o tipo de IA mais comum atualmente. Refere-se a sistemas projetados para realizar tarefas específicas de forma eficiente, como recomendar produtos em sites de e-commerce, reconhecer rostos em fotografias ou traduzir idiomas automaticamente. Esses sistemas não possuem consciência nem compreensão real; eles apenas executam funções programadas ou aprendidas com dados.

Exemplos de aplicações:

- Assistentes virtuais (como Alexa, Siri e Google Assistant);

- Sistemas de recomendação (Netflix, Spotify);

- Detecção de fraudes bancárias;

- Chatbots em serviços de atendimento.

IA Forte (General AI)

Trata-se de uma IA hipotética, ainda não alcançada. O conceito envolve a criação de máquinas com inteligência geral, capazes de compreender e executar qualquer tarefa cognitiva que um humano conseguiria realizar, com capacidade de aprendizado, raciocínio abstrato, planejamento e criatividade.

IA Superinteligente

Ainda no campo da teoria, é uma forma de inteligência que ultrapassaria a capacidade humana em todas as áreas, incluindo criatividade, sabedoria, habilidades sociais e tomada de decisão. Levanta questões éticas, filosóficas e de segurança.

2. Abordagens Paradigmáticas da IA

IA Simbólica

Parte do princípio de que a inteligência pode ser representada por regras lógicas e manipulação de símbolos. A mente é vista como um sistema simbólico formal, semelhante a um programa tradicional. Usada em sistemas especialistas, prova automatizada de teoremas e agentes com regras lógicas.

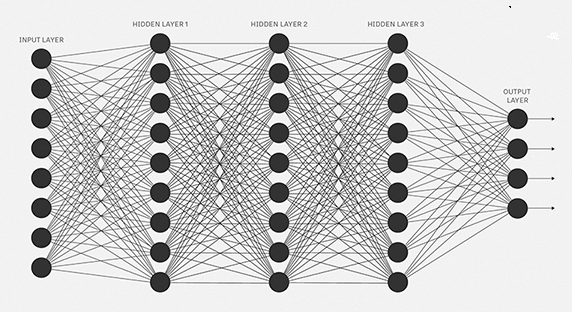

IA Conexionista

Inspirada na estrutura do cérebro humano, usa redes neurais para aprender com dados. Não há regras fixas. Exemplos incluem reconhecimento de fala, imagem, e previsão de tendências de mercado.

IA Evolucionária

Baseada na ideia de evolução biológica. Usa algoritmos genéticos, mutação e cruzamento para encontrar soluções. Usada em otimização logística, design de robôs, e geração automática de algoritmos.

O Impacto da Inteligência Artificial na Sociedade: Setores e Aplicações

IA na Saúde: Diagnóstico por Imagem e Assistência Médica

O setor de saúde tem se beneficiado amplamente do uso de sistemas de IA, especialmente no diagnóstico por imagem. Algoritmos treinados com milhares de exames médicos (como radiografias, tomografias e ressonâncias magnéticas) podem identificar padrões de doenças com precisão igual ou superior à de médicos experientes.

Exemplos práticos:

- Sistemas que detectam sinais precoces de câncer de mama em mamografias;

- IA aplicada a exames de retina para diagnosticar diabetes;

- Algoritmos que predizem chances de complicações em UTIs.

Além dos diagnósticos, a IA também está presente em assistentes clínicos digitais, como o Babylon Health, que interagem com pacientes, analisam sintomas e propõem possíveis causas para serem validadas por um profissional humano.

IA na Educação: Plataformas Adaptativas e Personalização do Ensino

A educação é outro campo que passa por grandes transformações com a IA. Sistemas educacionais inteligentes adaptam o conteúdo ao ritmo, estilo e desempenho de cada estudante.

Exemplos práticos:

- Plataformas como Khan Academy e Duolingo utilizam IA para sugerir lições personalizadas;

- Sistemas de tutoria inteligente que detectam dificuldades em tempo real;

- Análise preditiva para identificar alunos em risco de evasão.

A IA não substitui o professor, mas atua como uma assistente pedagógica, automatizando tarefas repetitivas (como correção de provas) e permitindo que o docente dedique mais tempo à mediação de processos de aprendizagem.

IA no Comércio: Motores de Recomendação e Personalização da Experiência

O comércio eletrônico e o varejo são áreas em que a IA se tornou essencial. Sistemas de recomendação analisam o comportamento de consumo dos usuários e sugerem produtos com alta probabilidade de interesse.

Exemplos práticos:

- A Amazon recomenda produtos com base em compras anteriores e comportamento de navegação;

- Supermercados online ajustam preços dinamicamente com base na demanda e no perfil do cliente;

- Chatbots que orientam o consumidor durante a compra, melhorando a experiência.

Esse uso intensivo de dados levanta questões sobre privacidade, que precisam ser abordadas com legislação adequada e ética no uso de algoritmos.

IA no Jornalismo: Geração Automatizada de Notícias

Ferramentas baseadas em IA já são usadas por grandes agências de notícias para gerar automaticamente conteúdo jornalístico a partir de dados estruturados, especialmente em coberturas financeiras, esportivas ou eleitorais.

Exemplos práticos:

- A Associated Press usa algoritmos para escrever relatórios financeiros;

- O jornal The Washington Post desenvolveu o robô “Heliograf” para cobrir eleições locais;

- IA usada para verificar fatos (fact-checking) em tempo real.

Embora a IA automatize a produção de informações, o papel do jornalista permanece essencial na curadoria, investigação e ética da comunicação.

IA no Direito: Previsão de Julgamentos e Apoio Jurídico

No campo jurídico, a IA auxilia na análise de jurisprudências, identifica padrões de decisões e oferece suporte na redação de documentos legais. É também utilizada para prever prováveis resultados de processos.

Exemplos práticos:

- Sistemas de “legal analytics” que estimam chances de êxito de um processo;

- Ferramentas que automatizam a busca por precedentes em bases de dados;

- Plataformas que redigem contratos com base em modelos personalizados.

Essas ferramentas não substituem os advogados, mas aumentam a eficiência e acessibilidade da justiça.

IA na Arte: Geração de Conteúdo Criativo

A IA também entra no terreno da criatividade, com sistemas capazes de compor músicas, pintar quadros, escrever poesias e gerar imagens e vídeos a partir de descrições textuais.

Exemplos práticos:

- O programa DALL·E gera imagens realistas a partir de comandos de texto;

- O sistema AIVA compõe músicas clássicas em diferentes estilos;

- Ferramentas como Runway e Midjourney são usadas por artistas e designers.

A existência de uma arte criada por inteligências artificiais reabre debates sobre autoria, originalidade e os limites entre o humano e o artificial.

O que são Modelos de Linguagem (LLMs)? Uma introdução acessível para todos

A inteligência artificial (IA) moderna revolucionou a forma como interagimos com computadores. Um dos principais avanços recentes são os chamados Modelos de Linguagem de Grande Escala, conhecidos como LLMs (do inglês Large Language Models). Neste texto, você vai entender de forma simples e clara o que são esses modelos, como funcionam, onde são aplicados, e quais impactos estão provocando na vida cotidiana e profissional.

O que é um Modelo de Linguagem?

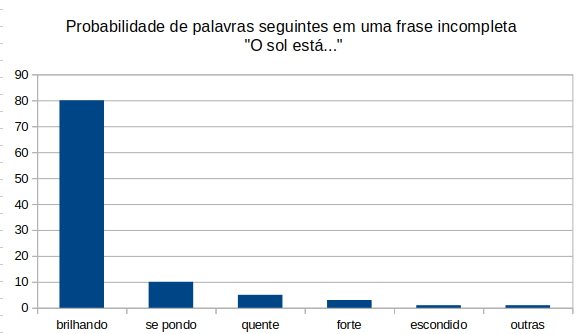

Modelos de linguagem são sistemas computacionais treinados para compreender e gerar linguagem humana. Seu objetivo é prever a próxima palavra de uma frase com base no contexto fornecido. Para isso, analisam padrões em grandes volumes de textos: livros, artigos, sites, e conversas em fóruns online, entre outros.

Exemplo simples: se você escrever “O céu está…”, o modelo completa com algo provável como “azul” ou “nublado”.

Esses modelos funcionam como “estatísticos da linguagem”: eles avaliam quais palavras costumam aparecer juntas e em que sequências.

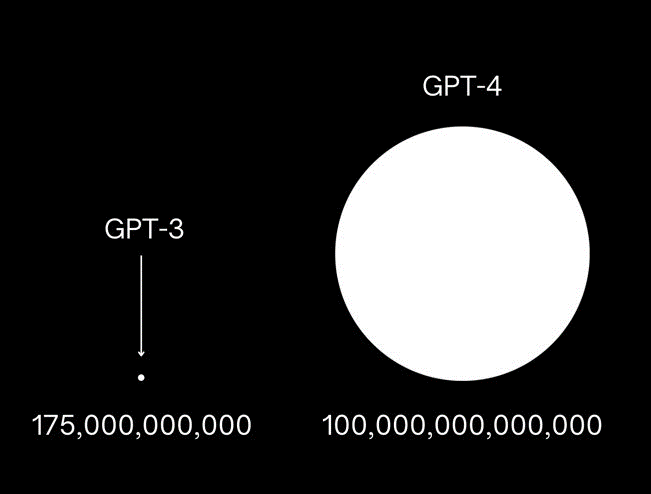

Por que “de Grande Escala” (LLMs)?

Os modelos mais recentes são chamados de LLMs porque são treinados com conjuntos de dados gigantescos (centenas de bilhões de palavras) e têm milhões ou bilhões de parâmetros internos. Esses parâmetros são os elementos que armazenam o “conhecimento” adquirido durante o treinamento.

Importante saber:

-

Quanto maior o modelo e mais diversificado o conjunto de textos, melhor sua capacidade de entender contextos complexos.

-

Eles não “entendem” como um humano, mas reconhecem padrões de maneira surpreendentemente eficaz.

Como os LLMs são treinados?

O processo de treinamento de um modelo de linguagem envolve duas etapas principais:

a) Treinamento Inicial (Pré-treinamento)

Nesta fase, o modelo é exposto a uma vasta quantidade de texto e aprende a prever a próxima palavra. É como ensinar uma criança a completar frases observando como as pessoas falam ou escrevem.

b) Ajuste Fino (Fine-tuning)

Depois de aprender a linguagem geral, o modelo pode ser ajustado para tarefas específicas, como responder perguntas, gerar código de programação ou resumir textos.

Exemplo: O ChatGPT passou por fine-tuning com intervenção humana para melhorar a forma como responde perguntas de forma mais segura e útile.

O que um LLM consegue fazer?

LLMs são incrivelmente versáteis. Entre suas aplicações estão:

-

Responder perguntas (como um oráculo digital);

-

Escrever textos de diferentes gêneros (notícias, cartas, roteiros, e-mails);

-

Traduzir idiomas;

-

Resumir textos longos;

-

Gerar códigos de programação;

-

Simular personagens ou autores;

-

Criar tutoriais, roteiros, planos de aula e muito mais.

LLMs são “inteligentes”? Compreendem o que dizem?

Não exatamente. Embora os LLMs possam gerar textos coerentes e realistas, eles não têm consciência, emoções ou intencionalidade. Eles são sistemas estatísticos avançados que operam com base em padrões linguísticos.

Importante: Um LLM pode parecer “inteligente”, mas não compreende como um ser humano. Pode cometer erros factuais e inventar informações (o que se chama de alucinação do modelo).

Exemplos famosos de LLMs

-

ChatGPT (OpenAI): voltado para conversa e assistência.

-

Bard (Google): interação em tempo real com busca integrada.

-

Claude (Anthropic): prioriza respostas seguras e contextualizadas.

-

LLaMA (Meta): voltado para pesquisa e open source.

-

Gemini (Google DeepMind): multimodal e em integração com outros sistemas.

LLMs e o futuro do trabalho

Esses modelos já estão sendo utilizados para automatizar tarefas repetitivas, criar conteúdo, oferecer suporte ao cliente, entre outros. Isso não significa apenas substituição de mão de obra, mas transformação de perfis profissionais.

Mudanças esperadas:

-

Redefinição de funções em marketing, jornalismo, direito, serviços;

-

Surgimento de novas profissões: engenheiro de prompt, curador de IA, testador de respostas;

-

Necessidade de educação continuada.

Limitações e cuidados

Apesar de sua potência, os LLMs têm limites:

-

Podem inventar fatos ou distorcer dados;

-

Reproduzem viés de gênero, raça, classe, presentes nos textos usados no treinamento;

-

Não possuem acesso à realidade em tempo real (a menos que integrados a buscadores);

-

Dependem de energia e recursos computacionais intensivos.

Considerações Finais

A Aula 01 oferece uma introdução fundamental ao vasto e dinâmico campo da Inteligência Artificial, contextualizando seu desenvolvimento histórico, abordagens metodológicas e desafios contemporâneos. A disciplina demonstra que a IA não é uma tecnologia isolada, mas sim um conjunto de paradigmas e estratégias que evoluíram ao longo de décadas, moldando-se conforme avanços teóricos, poder computacional e disponibilidade de dados.

Destaca-se a importância dos Modelos de Linguagem de Grande Escala (LLMs) como uma das expressões mais avançadas da IA atual, possibilitando aplicações que vão desde chatbots inteligentes até ferramentas de geração de texto automatizada. Essa transição da IA simbólica para abordagens conexionistas baseadas em aprendizado profundo representa uma ruptura de paradigma e uma nova fase na automação do raciocínio e do processamento da linguagem natural.

Com isso, torna-se evidente que compreender a IA contemporânea — especialmente em seu foco nos LLMs — exige tanto o domínio dos fundamentos históricos e conceituais quanto a análise crítica de suas implicações éticas, sociais e técnicas. Este primeiro contato com o tema prepara o terreno para um aprofundamento futuro, promovendo uma compreensão mais robusta do papel da IA na sociedade e nas práticas computacionais modernas.

Fim da Aula 01.